🤖 Beyond Code: The New Ethics of the Algorithm and the Responsibility Affecting Millions [ENG/GER/KOR]

ENGLISH VERSION:

🤖 Beyond Code: The New Ethics of the Algorithm and the Responsibility Affecting Millions

Imagine waking up, unlocking your phone, and discovering that an algorithm decided you are not eligible for a bank loan 🏦. Or that your resume was automatically discarded before a human even read it 💼. Or even, that the news feed shaping your worldview was curated to keep you outraged 📰.

Welcome to the reality of 2024. This isn't science fiction; it's our daily life.

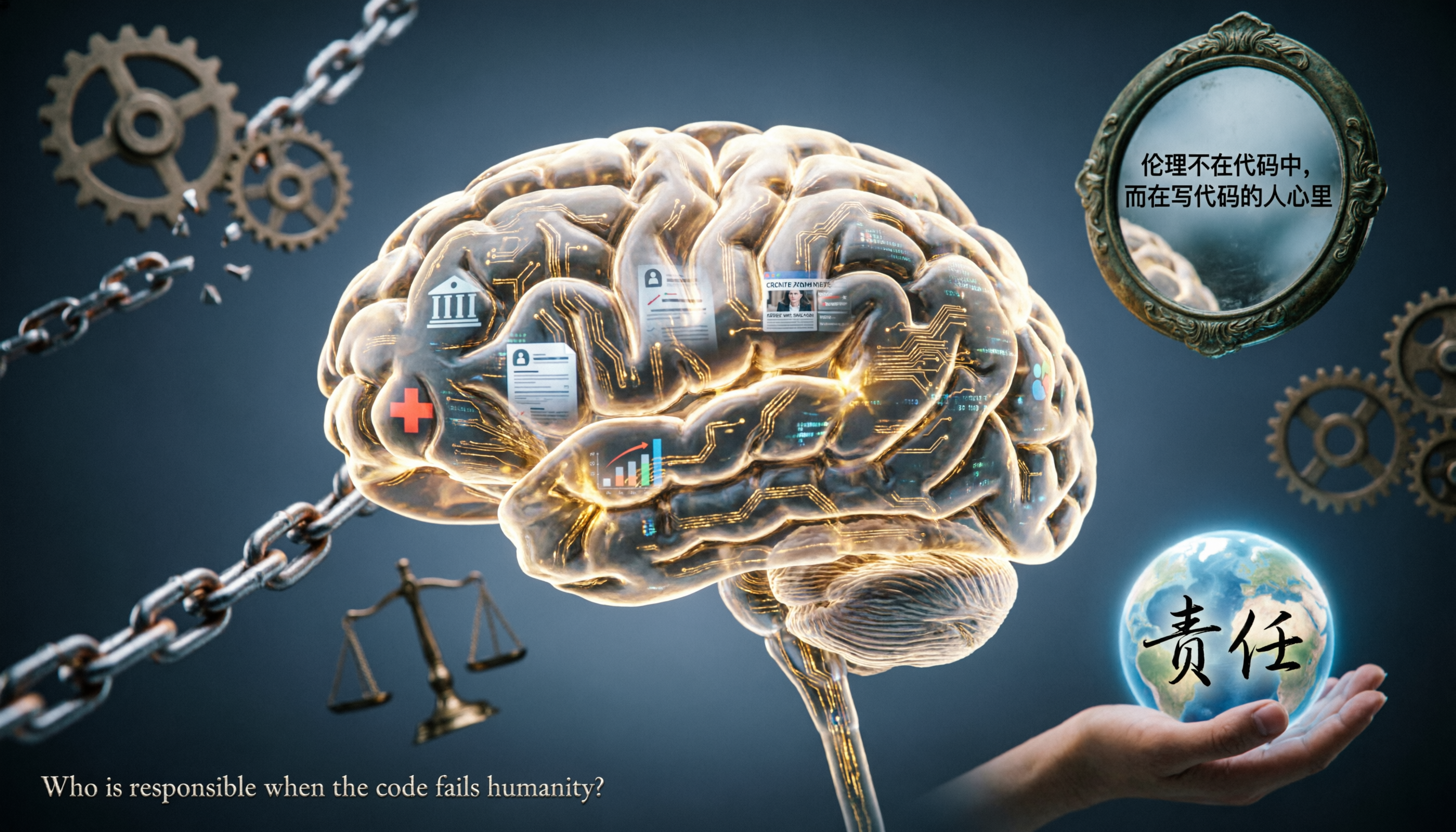

As Artificial Intelligence (AI) and automated systems take on crucial roles in decision-making, an urgent question arises: who is responsible when the code fails humanity? 🤔

In this post, we will dive into the new ethics of the algorithm and explore why responsibility for these decisions cannot be outsourced to machines.

🌐 The Invisible (and Digital) Hand

In the past, decisions affecting millions were made in boardrooms by administrative councils or governments. Today, many of these decisions occur in milliseconds, on cloud servers ☁️.

Algorithms determine:

- 🚔 Justice: Who has a higher risk of criminal recidivism?

- 🏥 Health: Who receives priority in treatments or diagnoses?

- 📢 Information: Which news goes viral and which is silenced?

- 💰 Finance: Who has access to credit?

The problem isn't efficiency. The problem is opacity.

📦 The "Black Box" Problem

Many modern Deep Learning systems function as black boxes. We know what data goes in and what results come out, but the exact logical path the AI took to reach that conclusion is, often, incomprehensible even to its own creators 🧠❓.

How can we demand ethical responsibility from a system that cannot explain the "why" behind its decisions?

Transparency is not a luxury, it is a human right in the digital age. 🛡️

⚖️ Bias in the Code: Society's Mirror

There is a dangerous myth that "numbers don't lie" and that machines are neutral. This is false. 🛑

Algorithms are trained with historical data. And human history is full of prejudices, inequalities, and discriminations. If a hiring algorithm is trained with data from a company that, for decades, hired mostly men, it will learn that "man" is synonymous with "ideal candidate" 👨💼🚫👩💼.

This is not a bug; it is automated systemic bias. When we scale this to millions of users, we aren't just making a mistake; we are institutionalizing discrimination at record speed.

🫵 The Responsibility Dilemma: Who Pays the Bill?

When an autonomous car causes an accident, whose fault is it? 🚗💥

- The programmer who wrote the code? 👨💻

- The tech company that profited from the software? 🏢

- The user who was in the driver's seat? 🧍

- Or the AI itself? (Spoiler: Machines don't go to prison).

Currently, we live in an accountability vacuum. Big tech companies often hide behind complex terms of use to avoid accountability. The new ethics of the algorithm requires that humans remain in the loop for critical decisions 🔄.

🛤️ The Path to Ethical AI

It's not about stopping technological progress, but guiding it with a moral compass. 🧭 Here are the pillars for this new ethics:

- Algorithmic Audit: High-impact systems must undergo bias and safety testing before and during use 🔍.

- Explainability (XAI): If a decision affects someone's life, there must be an understandable explanation of how it was made 🗣️.

- Robust Regulation: Laws like the European Union's AI Act are important steps, but they need global adoption 📜.

- Diversity in Teams: Homogeneous teams create products with blind spots. Diversity is an ethical security tool 🌈.

🚀 Conclusion: The Future is a Choice

Technology is a powerful tool, but it is amoral. It amplifies the intent of those who create it and those who regulate it. 🔊

The new ethics of the algorithm is not about restricting innovation, but about ensuring that innovation serves society, not the other way around. Decisions that affect millions require responsibility from millions (or at least, from those who hold the power).

Next time you interact with an AI, ask yourself: do I know why this happened? And if it goes wrong, who will answer for it?

The future will not be written only in Python or C++. It will be written in values. ✍️❤️

💬 Let's Talk!

Have you ever felt harmed by an automated decision? How do you think companies should be punished for discriminatory algorithms? Leave your opinion in the comments! 👇

🔖 Tags: #AIEthics #Technology #Algorithms #DigitalResponsibility #FutureOfWork #DataPrivacy #ResponsibleInnovation

📢 Share this post if you believe technology needs human consciousness! 🔄📲

GERMAN VERSION:

🤖 Jenseits des Codes: Die neue Ethik des Algorithmus und die Verantwortung, die Millionen betrifft

Stellen Sie sich vor, Sie wachen auf, entsperren Ihr Smartphone und entdecken, dass ein Algorithmus entschieden hat, dass Sie nicht für einen Bankkredit berechtigt sind 🏦. Oder dass Ihr Lebenslauf automatisch aussortiert wurde, bevor ihn ein Mensch überhaupt gelesen hat 💼. Oder sogar, dass der News-Feed, der Ihre Weltsicht prägt, so kuratiert wurde, dass Sie empört bleiben 📰.

Willkommen in der Realität des Jahres 2024. Das ist keine Science-Fiction; das ist unser Alltag.

Während Künstliche Intelligenz (KI) und automatisierte Systeme entscheidende Rollen bei der Entscheidungsfindung übernehmen, stellt sich eine dringende Frage: Wer ist verantwortlich, wenn der Code die Menschheit im Stich lässt? 🤔

In diesem Beitrag tauchen wir in die neue Ethik des Algorithmus ein und untersuchen, warum die Verantwortung für diese Entscheidungen nicht an Maschinen ausgelagert werden kann.

🌐 Die unsichtbare (und digitale) Hand

Früher wurden Entscheidungen, die Millionen betrafen, in Sitzungssälen von Verwaltungsräten oder Regierungen getroffen. Heute erfolgen viele dieser Entscheidungen in Millisekunden auf Cloud-Servern ☁️.

Algorithmen bestimmen:

- 🚔 Justiz: Wer hat ein höheres Risiko für kriminelle Rückfälligkeit?

- 🏥 Gesundheit: Wer erhält Priorität bei Behandlungen oder Diagnosen?

- 📢 Information: Welche Nachrichten werden viral und welche werden zum Schweigen gebracht?

- 💰 Finanzen: Wer hat Zugang zu Krediten?

Das Problem ist nicht die Effizienz. Das Problem ist die Undurchsichtigkeit.

📦 Das Problem der "Black Box"

Viele moderne Deep-Learning-Systeme funktionieren wie Black Boxes. Wir wissen, welche Daten hineingehen und welche Ergebnisse herauskommen, aber der genaue logische Pfad, den die KI genommen hat, um zu dieser Schlussfolgerung zu gelangen, ist oft selbst für ihre eigenen Entwickler unverständlich 🧠❓.

Wie können wir ethische Verantwortung von einem System verlangen, das das "Warum" hinter seinen Entscheidungen nicht erklären kann?

Transparenz ist kein Luxus, sondern ein Menschenrecht im digitalen Zeitalter. 🛡️

⚖️ Vorurteile im Code: Der Spiegel der Gesellschaft

Es gibt einen gefährlichen Mythos, dass "Zahlen nicht lügen" und Maschinen neutral seien. Das ist falsch. 🛑

Algorithmen werden mit historischen Daten trainiert. Und die menschliche Geschichte ist voller Vorurteile, Ungleichheiten und Diskriminierungen. Wenn ein Einstellungsalgorithmus mit Daten eines Unternehmens trainiert wird, das jahrzehntelang überwiegend Männer eingestellt hat, lernt er, dass "Mann" synonym mit "idealer Kandidat" ist 👨💼🚫👩💼.

Das ist kein Bug; es ist automatisierte systemische Verzerrung. Wenn wir dies auf Millionen von Nutzern hochskalieren, begehen wir nicht nur einen Fehler; wir institutionalisieren Diskriminierung in Rekordgeschwindigkeit.

🫵 Das Verantwortungs-Dilemma: Wer zahlt die Zeche?

Wenn ein autonomes Fahrzeug einen Unfall verursacht, wessen Schuld ist es dann? 🚗💥

- Der Programmierer, der den Code geschrieben hat? 👨💻

- Das Technologieunternehmen, das mit der Software Profit gemacht hat? 🏢

- Der Nutzer, der auf dem Fahrersitz saß? 🧍

- Oder die KI selbst? (Spoiler: Maschinen kommen nicht ins Gefängnis).

Derzeit leben wir in einem Verantwortungsvakuum. Große Tech-Unternehmen verstecken sich oft hinter komplexen Nutzungsbedingungen, um sich der Rechenschaftspflicht zu entziehen. Die neue Ethik des Algorithmus erfordert, dass Menschen bei kritischen Entscheidungen im Loop bleiben 🔄.

🛤️ Der Weg zu ethischer KI

Es geht nicht darum, den technologischen Fortschritt zu stoppen, sondern ihn mit einem moralischen Kompass zu lenken. 🧭 Hier sind die Säulen für diese neue Ethik:

- Algorithmisches Audit: Systeme mit hoher Wirkung müssen vor und während des Einsatzes auf Verzerrungen und Sicherheit getestet werden 🔍.

- Erklärbarkeit (XAI): Wenn eine Entscheidung das Leben eines Menschen beeinflusst, muss es eine verständliche Erklärung geben, wie sie zustande kam 🗣️.

- Robuste Regulierung: Gesetze wie der AI Act der Europäischen Union sind wichtige Schritte, benötigen aber globale Umsetzung 📜.

- Vielfalt in Teams: Homogene Teams erstellen Produkte mit blinden Flecken. Vielfalt ist ein Werkzeug für ethische Sicherheit 🌈.

🚀 Fazit: Die Zukunft ist eine Wahl

Technologie ist ein mächtiges Werkzeug, aber sie ist amoralisch. Sie verstärkt die Absicht derer, die sie schaffen, und derer, die sie regulieren. 🔊

Die neue Ethik des Algorithmus bedeutet nicht, Innovation einzuschränken, sondern sicherzustellen, dass Innovation der Gesellschaft dient – und nicht umgekehrt. Entscheidungen, die Millionen betreffen, erfordern Verantwortung von Millionen (oder zumindest von denen, die die Macht innehaben).

Das nächste Mal, wenn Sie mit einer KI interagieren, fragen Sie sich: Weiß ich, warum das passiert ist? Und wenn es schiefgeht, wer wird dafür geradestehen?

Die Zukunft wird nicht nur in Python oder C++ geschrieben. Sie wird in Werten geschrieben. ✍️❤️

💬 Lasst uns sprechen!

Haben Sie sich schon einmal durch eine automatisierte Entscheidung benachteiligt gefühlt? Wie sollten Ihrer Meinung nach Unternehmen für diskriminierende Algorithmen zur Verantwortung gezogen werden? Hinterlassen Sie Ihre Meinung in den Kommentaren! 👇

🔖 Tags: #KIEthik #Technologie #Algorithmen #DigitaleVerantwortung #ZukunftDerArbeit #Datenschutz #VerantwortungsvolleInnovation

📢 Teilen Sie diesen Beitrag, wenn Sie glauben, dass Technologie menschliches Bewusstsein braucht! 🔄📲

KOREAN VERSION:

🤖 코드를 넘어서: 알고리즘의 새로운 윤리와 수백 만 명에게 영향을 미치는 책임

상상해 보세요. 아침에 일어나 스마트폰 잠금을 해제했는데, 알고리즘이 당신에게 은행 대출 자격이 없다고 결정했다면 어떻게 할까요? 🏦. 아니면 당신의 이력서가 인간이 읽기도 전에 자동으로 탈락 처리되었다면요? 💼. 혹은 심지어 당신의 세계관을 형성하는 뉴스 피드가 당신을 분노하게 유지하도록 큐레이션되었다면요? 📰.

2024 년의 현실에 오신 것을 환영합니다. 이는 공상 과학 소설이 아니라 우리의 일상입니다.

인공지능 (AI) 과 자동화 시스템이 의사 결정에서 중요한 역할을 맡으면서 긴급한 질문이 제기됩니다: 코드가 인간성을 실패하게 할 때 누가 책임져야 할까요? 🤔

이 게시글에서 우리는 알고리즘의 새로운 윤리로 깊이 들어가서 왜 이러한 결정에 대한 책임을 기계에 아웃소싱할 수 없는지 탐구할 것입니다.

🌐 보이지 않는 (그리고 디지털적인) 손

과거에는 수백 만 명에게 영향을 미치는 결정은 행정 위원회나 정부에 의해 회의실에서 이루어졌습니다. 오늘날 이러한 결정 중 많은 부분은 클라우드 서버 ☁️ 에서 밀리초 단위로 이루어집니다.

알고리즘은 다음을 결정합니다:

- 🚔 사법: 누가 범죄 재범 위험이 더 높나요?

- 🏥 건강: 누가 치료나 진단에서 우선순위를 받나요?

- 📢 정보: 어떤 뉴스가 바이러스처럼 퍼지고 어떤 뉴스는 침묵하나요?

- 💰 금융: 누가 신용 대출에 접근할 수 있나요?

문제는 효율성이 아닙니다. 문제는 불투명성입니다.

📦 "블랙박스"의 문제

많은 현대 딥 러닝 (Deep Learning) 시스템은 블랙박스처럼 작동합니다. 어떤 데이터가 들어가고 어떤 결과가 나오는지는 알지만, AI 가 그 결론에 도달하기 위해 거친 정확한 논리적 경로는 종종 개발자 자신에게도 이해할 수 없습니다 🧠❓.

결정 뒤의 "이유"를 설명할 수 없는 시스템에 어떻게 윤리적 책임을 요구할 수 있을까요?

투명성은 사치스러운 것이 아니라 디지털 시대의 인권입니다. 🛡️

⚖️ 코드 속 편향: 사회의 거울

"숫자는 거짓말을 하지 않는다" 그리고 기계는 중립적이라는 위험한 신화가 있습니다. 이는 거짓입니다. 🛑

알고리즘은 역사적 데이터로 훈련됩니다. 그리고 인간의 역사는 편견, 불평등, 차별로 가득 차 있습니다. 만약 채용 알고리즘이 수십 년 동안 주로 남성을 채용한 회사의 데이터로 훈련된다면, 그것은 "남성"을 "이상적인 후보자"와 동의어로 학습할 것입니다 👨💼🚫👩💼.

이는 버그가 아닙니다; 이는 자동화된 시스템적 편향입니다. 이를 수백 만 명의 사용자로 확장할 때, 우리는 단순히 실수를 하는 것이 아니라 전례 없는 속도로 차별을 제도화하고 있습니다.

🫵 책임의 딜레마: 누가 대가를 치르는가?

자율주행차가 사고를 냈을 때, 누구의 잘못일까요? 🚗💥

- 코드를 작성한 프로그래머? 👨💻

- 소프트웨어로 이익을 낸 기술 기업? 🏢

- 운전석에 앉아 있던 사용자? 🧍

- 아니면 AI 자체? (스포일러: 기계는 감옥에 가지 않습니다).

현재 우리는 책임의 공백 속에 살고 있습니다. 대형 기술 기업들은 종종 책임을 회피하기 위해 복잡한 이용 약관 뒤에 숨습니다. 알고리즘의 새로운 윤리는 중요한 결정에서 인간이 루프 안에 남아있어야 함을 요구합니다 🔄.

🛤️ 윤리적 AI 로 가는 길

기술적 진보를 멈추는 것이 아니라 도덕적 나침반으로 이끄는 것입니다. 🧭 이 새로운 윤리를 위한 기둥은 다음과 같습니다:

- 알고리즘 감사: 영향력이 큰 시스템은 사용 전과 사용 중에 편향 및 안전성 테스트를 거쳐야 합니다 🔍.

- 설명 가능성 (XAI): 결정이 누군가의 삶에 영향을 미친다면, 어떻게 이루어졌는지 이해할 수 있는 설명이 있어야 합니다 🗣️.

- 강력한 규제: 유럽 연합의 AI 법 (AI Act) 과 같은 법률은 중요한 단계이지만, 글로벌 채택이 필요합니다 📜.

- 팀의 다양성: 동질적인 팀은 맹점이 있는 제품을 만듭니다. 다양성은 윤리적 안전 도구입니다 🌈.

🚀 결론: 미래는 선택입니다

기술은 강력한 도구이지만 비도덕적 (amoral) 입니다. 그것은 그것을 만들고 규제하는 사람들의 의도를 증폭시킵니다. 🔊

알고리즘의 새로운 윤리는 혁신을 제한하는 것이 아니라, 혁신이 사회에 봉사하도록 보장하는 것입니다. 수백 만 명에게 영향을 미치는 결정은 수백 만 명 (또는 적어도 권력을 쥔 사람들) 의 책임을 요구합니다.

다음에 AI 와 상호작용할 때 스스로에게 물어보세요: 나는 이것이 왜 일어났는지 아는가? 그리고 만약 잘못된다면 누가 대답할 것인가?

미래는 Python 이나 C++ 로만 쓰이지 않을 것입니다. 그것은 가치로 쓰일 것입니다. ✍️❤️

💬 이야기를 나눠봅시다!

자동화된 결정으로 인해 불이익을 받은 적이 있습니까? 차별적인 알고리즘에 대해 기업들이 어떻게 책임을 져야 한다고 생각하십니까? 댓글에 의견을 남겨주세요! 👇

🔖 태그: #AI 윤리 #기술 #알고리즘 #디지털책임 #미래의일 #데이터개인정보보호 #책임있는혁신

📢 기술이 인간의 의식이 필요하다고 믿으신다면 이 게시글을 공유해주세요! 🔄📲

Upvoted! Thank you for supporting witness @jswit.