맥북에서 로컬 AI(Ollama)와 함께 '사파리(Safari)'를 써야만 하는 이유

맥북에서 로컬 AI(Ollama)와 함께 '사파리(Safari)'를 써야만 하는 이유

안녕하세요, 가야태자 @talkit입니다.

최근 맥북(특히 M4 Pro 급 이상)에서 Ollama를 활용해 로컬 AI 번역기나 챗봇을 돌리시는 분들이 많아졌습니다. 저 역시 백그라운드에서 AI 번역기를 상시 가동하고 있는데요, 작업을 하다 보니 아주 흥미로운(그리고 중요한) 사실을 발견했습니다.

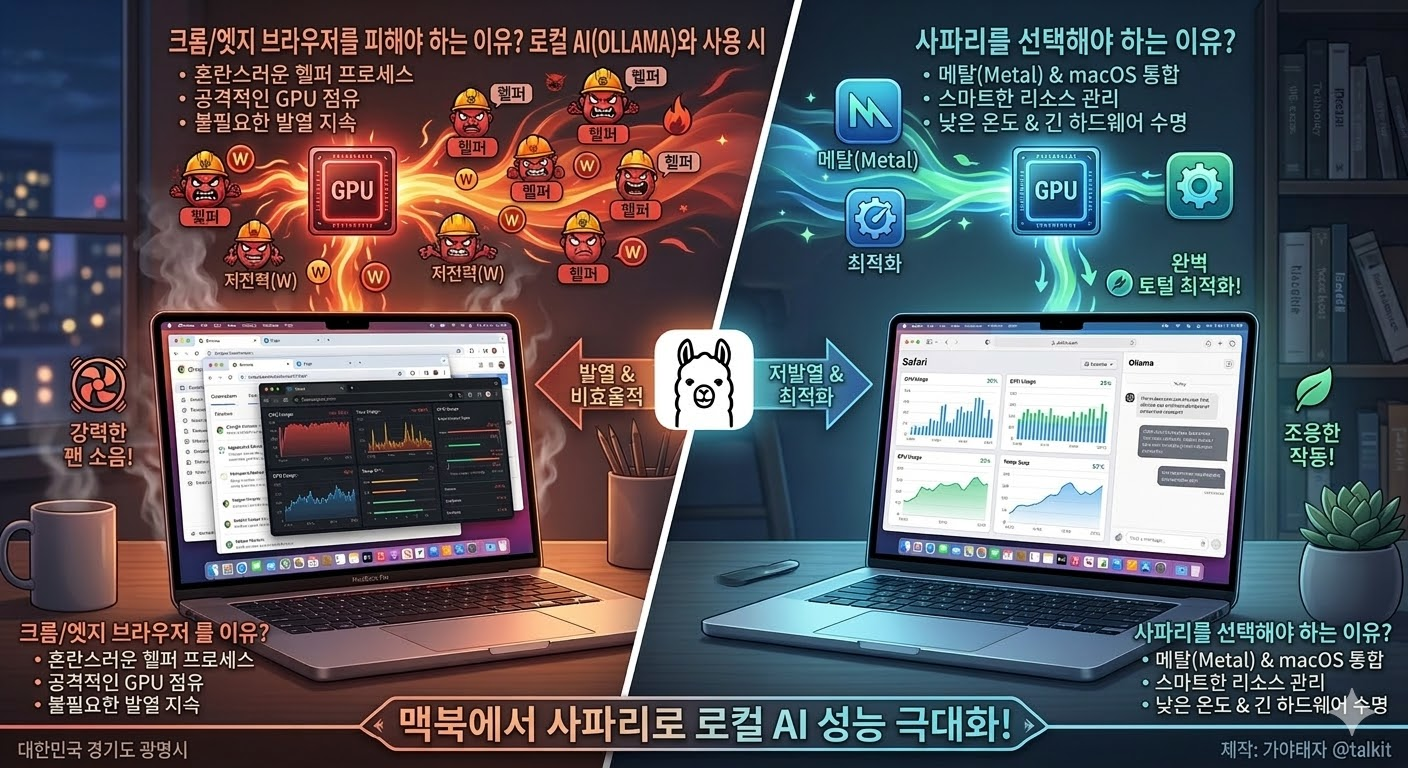

바로 "브라우저 하나만 바꿔도 노트북의 발열과 GPU 상태가 극적으로 변한다"는 점입니다. 오늘은 왜 맥북 유저가 로컬 AI를 돌릴 때 크롬이나 엣지 대신 사파리를 써야 하는지, 실제 경험을 바탕으로 정리해 보았습니다.

1. 크롬과 엣지의 '무서운' 헬퍼(Helper)들

구글 크롬이나 마이크로소프트 엣지는 'Chromium' 엔진을 기반으로 합니다. 이 엔진은 성능을 위해 각 탭과 플러그인을 별도 프로세스로 띄우는데, 이때 생성되는 수많은 'Helper' 프로세스들이 문제입니다.

- 이 헬퍼들은 그래픽 가속을 위해 GPU 자원을 아주 공격적으로 점유합니다.

mactop이나 활성 상태 보기로 조사해 보면, AI가 아무것도 안 하고 있을 때조차 이 녀석들이 GPU 코어를 계속 '괴롭히고' 있는 것을 볼 수 있습니다.

2. AI가 종료되어도 식지 않는 노트북?

로컬 AI(Ollama 등)는 연산할 때 엄청난 GPU 자원을 씁니다. 연산이 끝나면 AI는 자원을 반납하지만, 그 자리를 바로 크롬이나 엣지의 헬퍼들이 비집고 들어와 '알박기'를 시작합니다.

결국 AI는 꺼졌는데 노트북의 발열은 그대로인 상황이 발생합니다. VRAM(비디오 메모리)은 비워졌을지 몰라도, GPU 코어는 여전히 브라우저의 그래픽 처리를 위해 쉴 새 없이 돌고 있기 때문이죠.

3. 사파리는 '맥잘알'이다

반면, 애플이 직접 만든 사파리(Safari)는 다릅니다.

- 시스템 통합: macOS의 그래픽 엔진(Metal)과 가장 긴밀하게 최적화되어 있습니다.

- 스마트한 자원 관리: 사용하지 않는 탭의 GPU 점유를 즉시 최소화하며, 꼭 필요한 연산만 수행합니다.

- 실제 결과: 크롬과 엣지를 끄고 사파리만 켰을 뿐인데, GPU Usage 수치가 극적으로 낮아지고 팬 소음이 사라지는 마법을 경험할 수 있습니다.

💡 결론: 사파리 짱!

맥북에서 로컬 AI를 쾌적하게 활용하고 싶으신가요? AI 모델을 최적화하는 것도 중요하지만, 지금 바로 점유율 괴물인 크롬과 엣지를 끄고 사파리로 넘어오세요.

통합 메모리를 사용하는 애플 실리콘 맥북에게 사파리는 단순한 브라우저가 아니라, 하드웨어 수명을 늘려주는 최고의 최적화 도구입니다.

오늘부터 저녁에는 브라우저를 사파리로 바꾸고 잘 계획입니다. 여러분의 소중한 GPU 코어에게 휴식을 선물하세요! ^^

음 요즘 말씀 들린대로 맥북에서 AI와 열심히 놀고 있습니다.

그런데, AI로 번역기를 돌려야 합니다.

그래서 생각한 것이

- 번역을 한번 한다.

3분쯤 쉰다. (노트북 발열 해소 ^^)

이걸 무한 반복 한다였습니다.

그런데, 발열이 안식는 겁니다. ㅎㅎㅎ

그래서 바꿨습니다.

- 번역을 진행한다.

2 모든 올라마를 종료한다.

이걸 무한 반복 한다로 바꿨는데

올라마 프로세스가 없는데도 GPU가 거의 80%를 사용하고 온도가 높았습니다.

그래서 CPU사용율과 GPU사용율을 조사해보니 ㅠ.ㅠ

원인이 크롬과 엣지였습니다.

그래서 앞으로 맥북에서는 사파리만 사용하는 연습을 해야겠습니다.

감사합니다.

🎉 Congratulations!

Your post has been upvoted by the SteemX Team! 🚀

SteemX is a modern, user-friendly and powerful platform built for the Steem community.

🔗 Visit us: www.steemx.org

✅ Support our work — Vote for our witness: bountyking5